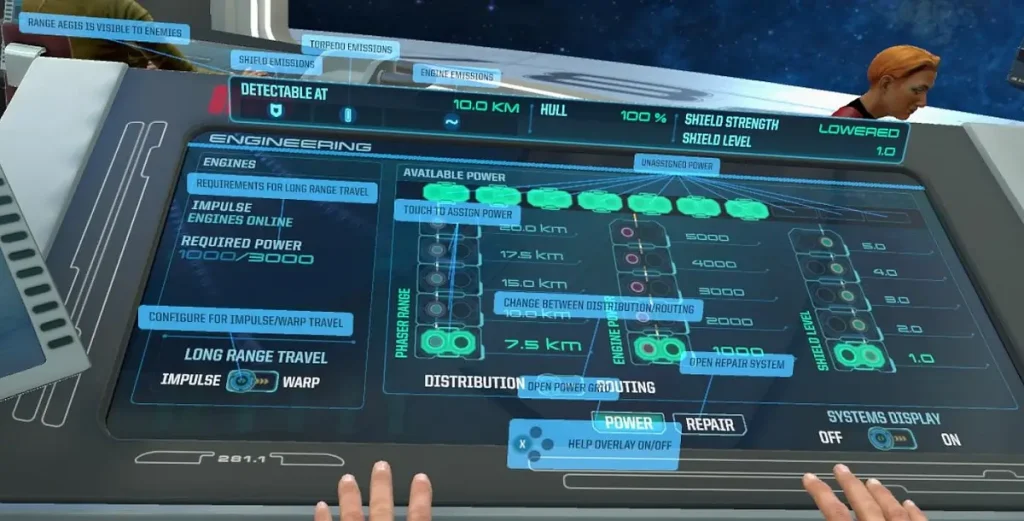

Un grupo de investigadores descubrió que muchas de las técnicas populares para mejorar las respuestas de los chatbots de inteligencia artificial (IA) no tienen efecto real. Sin embargo, un método inusual —pedirle a la IA que imagine escenarios como los de la saga Star Trek— logró mejorar su rendimiento en tareas como matemáticas básicas.

El estudio evaluó distintas estrategias utilizadas por usuarios al interactuar con modelos de lenguaje (LLM), la tecnología que impulsa herramientas como ChatGPT. Entre ellas, probaron halagos, mensajes positivos y frases motivacionales como “¡esto será divertido!”, pero ninguna mostró impacto significativo en la precisión de las respuestas.

No obstante, cuando los investigadores introdujeron un contexto específico —haciendo que la IA “actuara” dentro de un entorno de ciencia ficción— los resultados fueron distintos. Este enfoque permitió que los modelos generaran respuestas más estructuradas y lógicas, especialmente en ejercicios matemáticos.

Según expertos en inteligencia artificial, esto se debe a que los modelos responden mejor cuando reciben instrucciones claras y un marco contextual definido. Jules White, profesor de informática en la Universidad de Vanderbilt, explicó que no existe un “conjunto mágico de palabras” para obtener mejores resultados, sino que la clave está en cómo se formula la tarea.

El fenómeno forma parte de lo que se conoce como “ingeniería de prompts” o “ingeniería de contexto”, una práctica que busca optimizar la comunicación con sistemas de IA. Aunque circulan múltiples teorías en redes —desde amenazar a los chatbots hasta tratarlos con excesiva cortesía—, muchas de estas creencias carecen de respaldo técnico.

Los especialistas advierten que algunas de estas prácticas incluso pueden ser contraproducentes, ya que pueden generar respuestas menos precisas o inducir errores. En cambio, recomiendan centrarse en dar instrucciones específicas, definir roles y estructurar claramente las preguntas.

Deja tu comentario